2018通信领域研究报告(二)-5G应用大盘点5G应用大盘点 (一)5G网络将成为AI重要的基础

分布式核心网帮助AI将应用延伸到边缘网络切片为AI应用打造一个“私人定制”的网络AI将改变5G网络AI让“网随人动”AI让网络自治下一个时代,将是5G的时代,也是AI的时代(二)5G使AR迎来突破性增长机会说到 AR 眼镜,人们会立即想到 Magic Leap 或者 HoloLens。Magic Leap 自成立8年以来,融资超过20亿美元,但是目前还没有商业化产品落地。7月12日,它完成了 D 轮股权融资,还宣布 Magic Leap One 的开发者版将于近期面世,让我们拭目以待。而从产品角度来说,AR领域的先行者,美国增强现实科技公司 Meta 的第二代产品 Meta 2 的分辨率是 HoloLens 的4倍,也就是说可以提供更精细的视觉体验。此外,Meta 2 的视角是90度,HoloLens 的只有30度,而视角大小对虚拟场景的体验会产生直接影响。 Meta 的 CEO,以色列人 Meron Gribetz的创业经历,也是“创新上行”模式的实例,当产生小创意以后,充分利用各种众筹和孵化平台,在创业的每个阶段,都找到需要的长板进行对接,从而最终实现产品研发和商业化。 AR领域的先行者-Meron GribetzMeron 出生在以色列,曾服役于以色列国防军情报机构的技术部门。

Meta2 AR眼镜 那么,Meron 是如何产生这个创意的呢?这要从一次 TED 演讲说起。2009年,Meron 进入哥伦比亚大学学习计算机科学和神经科学。在哥大求学时,Meron 偶然看到了 MIT 印度裔工程师 Pranav Mistry 的 TED 演讲。在这个演讲中,Pranav 展示了一种手势操纵设备,可以运用双手对虚拟物体进行操纵,Pranav 演示了如何使用手势与外界进行交互。例如将双手在眼前摆成一个长方形,就能将长方形内的景色拍下来。这项技术深深地震撼了 Meron。 在一次采访中他说:这个演讲让我对于人机交互有了全新的理解。于是,他就开始思考如何开创一种全新的人机交互模式。2011年的一天晚上,Meron 和朋友在酒吧喝酒,正跟朋友讲述他对激光投影技术的理解,讨论这项技术将会如何取代目前的人机交互系统。Meron 正讲到兴头上时,朋友的手机突然亮了起来。和大多数人一样,他的朋友下意识地去看手机上的信息并开始回复。被忽视的 Meron 无奈环顾四周,看见酒吧里有一个人拿着手机正在向其他人展示 Instagram 上的一些搞笑图片。这个情景让他意识到,

Meron Gribetz做出的第一款AR眼镜样品 用现在的眼光看起来,确实非常简陋,根本称不上是一款产品。但是,这个眼镜对于 Meron 的创业之路却非常重要,随后在2012年,他创立了 Meta,总部设在美国湾区的 Redwood City。 众筹开启商业化之路在开发了第一款 AR 眼镜的样品之后,Meron 就面临如何实现商业化、缺乏启动资金等问题。2013年的5月,他在 Kickstarter 上开始为开发 Meta 的第一代产品 Meta 1 发起众筹。当时他的想法是:如果这款产品能引起大家的关注,那么证明存在切实需求,说不定还能解决前期开发费用。通过众筹还能获得产品反馈与建议,这样可以帮我更好地进行产品改进。其实他的做法很符合“最小可用品”的原则,也就是说, 发起众筹后,Meron 和他的同学就在宿舍内盯着电脑屏幕。很快第一笔订单出现了,购买者是伦敦的 ARUP 公司,这是一家跨国建筑设计公司。接着,第二笔订单显示在计算机屏幕上,居然是苹果公司联合创始人史蒂夫·沃兹尼亚克,他成为了 Meta 1 的第二位用户。当众筹结束后,总共有超过500名资助者。他们最终获得了将近20万美元,金额是预期筹款的两倍。

Meta 1 AR 眼镜 众筹大获成功后,2013年8月,Meta 公司被美国孵化器 Y Combinator 加入到种子加速计划当中,并取得了100万美元的天使投资。利用这几次的融资,公司获得了产品研发和推广的资金。 一年之后,在旧金山 TechCrunch Disrupt 的大会上,Meta 展示了他们开发的第一代产品 Meta 1,并开始向用户销售。当时,初期消费者主要以 AR 爱好者或者开发者为主。 值得提一下的是,尽管 Meron 自己没有什么启动资金,他所拥有的只是一个想法,一个创意,在尝试做出样品后,充分利用众筹和孵化平台,完成了创业公司早期融资,为产品优化迭代和公司运营提供了保障。并且,在成功试水以后,Meta 继续利用资本市场推动了公司的发展。 后续陆续完成了 A 轮和 B 轮融资,合计约8000万美元。其间就开始了第二代产品的开发,他们了解到用户对以下几个性能比较关注,比如: 基于这些用户反馈,Meta 团队便开始着手研发第二代 AR 眼镜。在2016年2月17日的 TED 大会上,Meron 首次对外展示了 Meta 第二代产品 Meta 2。它的视野宽度可以达到90度,同时图像分辨率也达到了2.5K的显示级别。

Meta 2 眼镜的Air Grab功能示意图 此外,他们研发的 Air Grab 技术,可以让用户通过双手直接对 AR 物体进行抓取、移动、旋转等操作。这个功能实现了他希望利用技术连接真实与虚拟世界,创造出比屏幕更加自然的人机交互界面的梦想。戴上 Meta 2 眼镜之后,就能用手直接操控投射在现实空间的虚拟物体,而不需要借助任何物理媒介。 AR眼镜的应用做产品研发的用户,应该对 CAD 建模软件 Solidworks 不会陌生,它大规模地应用在汽车、航空、机械等行业的研发工作中。拿 Solidworks 为例,看看这家公司是如何运用 Meta 的产品,打造 3D 建模平台的。当你戴上 AR 眼镜之后,眼前会出现一个圆形平台和一个储物架,在储物架上,存放着你最新设计的汽车车身 3D 模型。当你用手抓取了这个模型,把它放到圆形平台后,关于这个模型的所有参数与设计细节,将展现在平台左侧。同时在平台前方还有一系列的选项,不同选项代表不同的操作功能。你可以用手势,直接在 3D 模型上进行修改,比如你对某一区域的颜色或者材料不满意,可以直接将你喜欢的颜色,或者合适的材料拖拽到这里,模型就会立即更新。当 3D 模型设计确定后,用户将导出一种 GITF 格式的文件。它是一种开源的 3D 模型类型文件,这个文件包含以下信息: 这些参数都可以通过 AR 眼镜进行调整,只要用手就可以移动、缩放、展示和修改 3D 模型的细节。可见,与 AR 技术结合后的 3D CAD 建模工具,将改变未来的设计流程,大大提高研发效率和产品的展现方式。 总体来说,Meta 公司近80%的用户用 AR 眼镜主要从事产品研发工作,而其他研发 AR 眼镜的公司,例如微软 HoloLens,是以应用到游戏行业为主。 但是必须说明的是,Meta 2 的 AR 眼镜本身还不具备计算能力,它的计算能力取决于与它连接的手机或电脑的计算能力。此外,如果终端是智能手机的话,电量消耗也是主要的限制性环节。所以,目前看来,计算能力、追踪技术、数据传输速度是影响 AR 眼镜应用的主要因素。

Meta 3 AR 眼镜效果图 目前,Meta 正在研发第三代 AR 眼镜 Meta 3,这是一个看起来更小,更轻便的眼镜。2018年6月,在珠海举办的中国-以色列企业峰会上展出了第三代 AR 眼镜的样品,我们期待第三代产品尽快实现量产。 当然,可以预期的是,5G 通讯技术的逐步成熟,将一定程度上解决图像数据传输速度慢,反应时间长的问题。 基于目前的技术现状,以及未来可预期的计算能力、网络带宽、计算机视觉技术的发展,与 VR 相比,AR 技术将最早实现商业化落地。到时,无论在游戏,还是产品研发领域,都需要你积极探索,充分挖掘应用场景。 (三)5G助力智慧医疗进入快速发展新时代2017年10月28日,于“生命的诺亚方舟”——深圳国家基因库,华大智造携远程超声诊断系统重磅新品精彩亮相第十二届国际基因组学大会(ICG-12),用划时代跨界新品,普及优质医疗,让更多人享受生命关怀,践行“健康中国、健康世界”的梦想。 在来自全球的科学泰斗、科研翘楚、学界新星的共同见证下,华大基因执行副总裁、国际区域中心主任余德健发表了精彩致辞,揭开了这台划时代的远程超声诊断系统的神秘面纱。

华大基因执行副总裁、国际区域中心主任余德健致辞 本次发布的重磅新品——远程超声诊断系统 MGIUS-R3,由华大智造和众多合作商强强联合打造,借力国际顶尖的专用网络技术实现了远程精准操控,引领了现代远程超声的发展方向。华大智造影像研发中心副总监伍利先生为到场来宾就产品的性能与未来发展规划进行深刻阐述,同时将联合各合作伙伴一道共创医疗行业创新解决方案,携手建设“智慧医疗”生态圈,助推大健康行业升级发展。

华大智造影像研发中心副总监伍利介绍新产品 在这场大咖云集的发布会上,湖北省妇幼保健院超声科主任医师、卫生技术二级岗位教授、湖北省中医药大学硕士生导师陈欣林主任,深圳大学医学部生物医学工程学院副院长、广东省超声医学工程学会常务理事倪东教授,华为无线应用场景实验室王宇峰总裁,分别代表临床医学领域、科研领域与通讯应用领域的学术权威,同与会专家、学者分享基于跨界融合取得的一系列成果和对未来的展望。 实时诊断,大爱无疆据陈欣林主任介绍,最近10年,先天性心脏病一直高居我国出生缺陷的“榜首”,超声检查是目前检出胎儿心脏结构异常的惟一方法,胎儿到14周左右已经可以通过超声诊断是否存在结构异常。 远程超声诊断系统采用国际顶尖网络通讯技术,远程响应速度毫秒级,全面满足用户更高效、更快速,更精准的诊断需求。不仅如此,高灵敏度力反馈系统的应用,能在直径为800mm的空间内进行扫查,全面满足心脏、颈部、胸部及腹部等全身应用需求。

湖北省妇幼保健院超声科主任医师、卫生技术二级岗位教授、湖北省中医药大学硕士生导师陈欣林主任发表主旨演讲 智能科技,化繁为简倪东教授介绍,医学影像放射科工作量非常大。他指出在不久的未来人工智能可以实现成功辅助医务人员更高效的完成医疗诊断。 远程超声诊断系统集临床专家经验与数据分析技术、智能AI、深度学习等技术于一体,实现了高效的人机交互体验,使设备以病人为中心进行紧密的协作,并提供丰富的解决方案。深圳大学和华大智造的紧密合作,超声诊断系统的惊艳问世昭示着超声设备将迈入“智能化时代”,也昭示着华大智造开创了智能化超声系统的里程碑。

深圳大学医学部生物医学工程学院副院长、广东省超声医学工程学会常务理事倪东教授演讲 5G网络,如临其境王宇峰先生指出,进入5G时代后的移动通信领域,应用场景将从语音、数据不断扩展,与各个行业紧密联系,5G不单单是服务于人和人,同样服务于人和物以及垂直行业。 5G时代即将来临,智慧医疗步入了快速发展时期。远程超声诊断系统应运而生,上善若水。沟通畅如水:高清晰视频语音系统让专家和病人沟通畅通无阻 ; 信息疾如雨:数据传输实时高效,无延滞,响应时间为毫秒级别,图像传输不丢帧;智慧凝如露凝:远程调节超声图像的参数,实时快速诊断,提高医疗效率。

华为无线应用场景实验室王宇峰总裁演讲

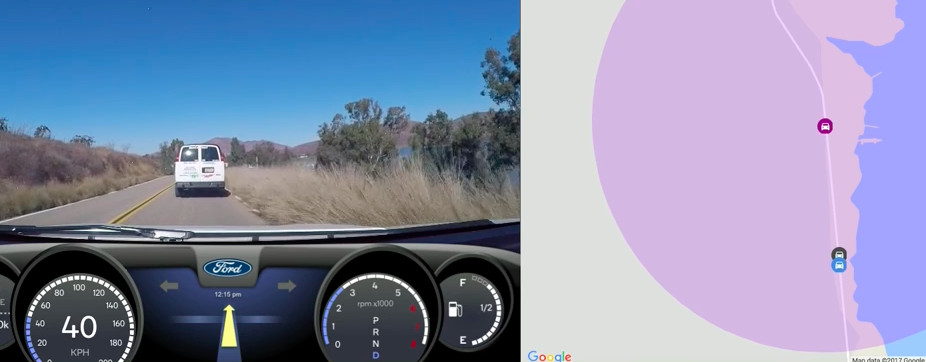

王宇峰总裁和刘健副总裁分别代表华为WirelessX Labs与华大智造完成智慧医疗合作意向书的签署。 在“互联网+医疗”的新时代,华大智造迎来了跨界发展的新契机,将优质医疗播撒在世界每一个需要的角落,让智造品牌闪耀全球,为人人健康贡献中国力量。 (四)5G在自动驾驶中必不可少C-V2X,C即Cellular,V2X就是vehicle-to-everything,指车与外界的信息交换,它是基于蜂窝网络的车联网技术。 C-V2X指从LTE-V2X到5G V2X的平滑演进,它不仅支持现有的LTE-V2X应用,还支持未来5G V2X的全新应用。它基于强大的3GPP生态系统和连续完善的蜂窝网络覆盖,可大幅降低未来自动驾驶和车联网部署成本。 与雷达、激光雷达等传感器不同,我们可以把V2X视为一种无线传感器系统的解决方案,它允许车辆通过通信信道彼此共享信息,它可检测隐藏的威胁,扩大自动驾驶感知范围,能预见接下来会发生什么,从而进一步提升自动驾驶的安全性、效率和舒适性。C-V2X被认为是自动驾驶的关键推动因素之一。 C-V2X能做什么呢?还是继续举例吧。

如上图,道路前方弯道处停有一辆抛锚的汽车,但由于正好处于弯道,汽车本地的摄像头、雷达等传感器无法检测到,眼看一场车祸正要酿成悲剧。 幸运的是,我们有V2X。

V2X通过通信网络共享信息,具有“耳听八方”的能力,此时汽车显示屏上会提示前方有车辆,并启动减速和转向,安全通过。 再来一个案例。

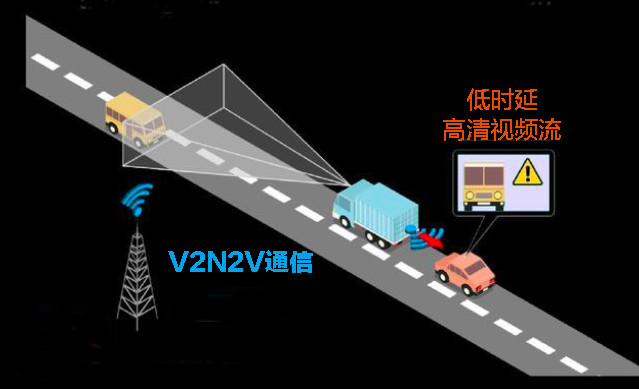

如上图,前方的大卡车挡住了视线,而对面正驶来一辆汽车,此时要超车,毫无疑问是非常危险的。 当驾驶员刚打左转灯准备超车时,V2X通过显示屏立即提示,前方有来车,不能超车…

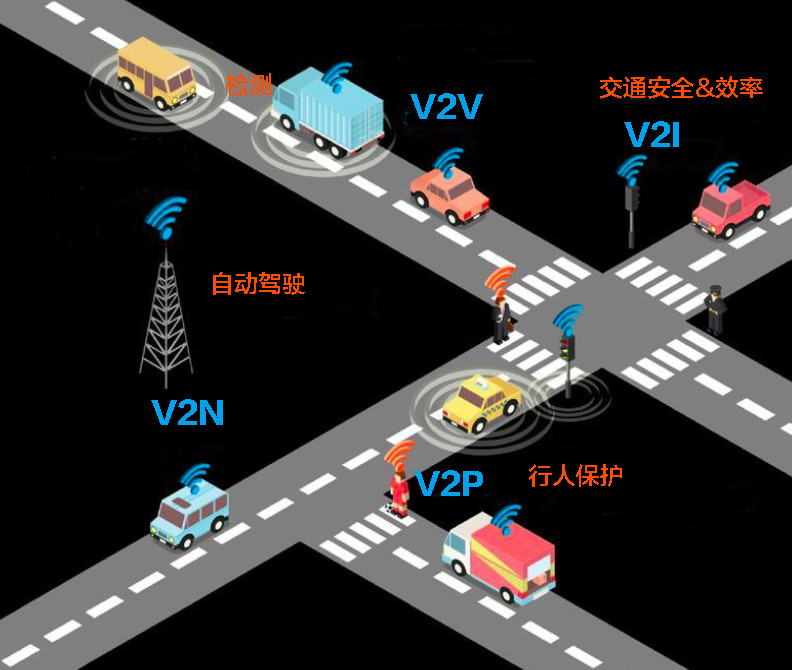

直到危险解除后,才顺利超车,安全通过。 V2X主要包括V2N(车辆与网络/云)、V2V(车辆与车辆)、V2I(车辆与道路基础设施)和V2P(车辆与行人)之间的连接性。

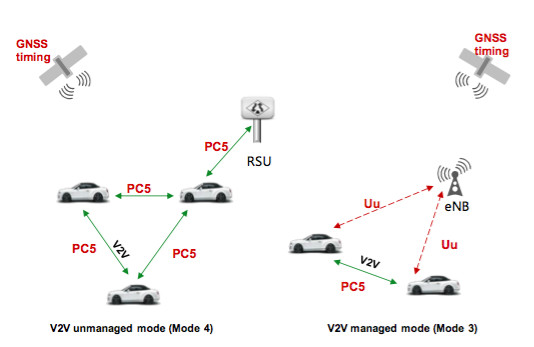

2015年,3GPP在Rel. 14版本中启动了基于LTE系统的V2X服务标准研究,即LTE-V2X,国内多家通信企业(华为、大唐、中兴)参与了LTE-V标准制定和研发。2016年9月,首版涵盖了V2V和V2I的V2X标准发布;2017年6月,进一步增强型V2X操作方案发布。 在Rel. 14中,V2V通信基于D2D( Device-to-Device)通信,其为Rel.12和Rel.13版本中的Proximity Services (ProSe) 近距离通信技术的一部分。新的D2D接口被命名为PC5接口,以实现可支持V2X要求的增强型功能,这些增强型功能包括:支持高达500Km / h的相对车速、支持eNB覆盖范围内的同步操作、提升资源分配性能、拥塞控制和流量管理等。 在Rel. 14中,LTE-V2X主要有两种操作模式:通过PC5接口点对点通信(V2V)和通过LTE-Uu与网络通信(V2N)。 基于PC5接口的V2V通信也包括两种模式:管理模式(PC5 Mode 3)和非管理模式(PC5 Mode 4),当网络参与车辆调度时称为管理模式,当车辆独立于网络时称为非管理模式。在非管理模式下,基于车辆间的分布式算法来进行流量调度和干扰管理;在管理模式下,通过Uu接口的控制信令由基站(eNB)辅助进行流量调度和干扰管理。

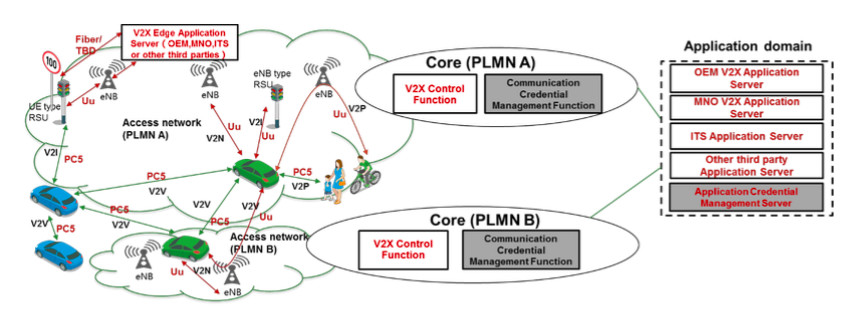

C-V2X还将持续平滑演进到5G V2X,将对功能进一步增强,以支持低延迟和高可靠性V2X服务。 除了PC5和Uu接口,C-V2X技术构架还包括V2X控制功能、边缘应用服务器和V2X应用服务器。

•V2X控制功能(V2X control function)位于核心网,其为实现V2X通信向UE提供必要的参数以执行相关网络动作。 •V2X应用服务器可部署于网络之外,由车企、移动运营商或第三方来运营,从而跨运营商跨车厂,这也解决了过去车企担心的依赖C-V2X会导致自动驾驶业务被电信运营商所控制的问题。 •边缘应用服务器靠近数据源部署,解决了时延和网络负荷问题,将在许多V2X用例(比如实时高清地图更新等)中发挥重要作用。 为何自动驾驶需要5G?目前基于LTE的V2N已经覆盖了很多车联网用例,比如交通信息提示、地图更新、OTA固件更新。未来V2V和V2I将广泛应用于车联网的低时延、远距离通信场景。 你可以将C-V2X看成是连接V2N和V2V/V2I的粘合剂,其依托于成熟的蜂窝网络生态,随着4G向5G的技术演进,将在未来自动驾驶领域发挥关键的作用。 基于5G近实时的高清视频传输,V2N和V2V互补(V2N2V)如前所述,让自动驾驶不仅能“眼观六路”,还能“耳听八方”,实现100%安全性。

5G网络切片技术提供始终如一的QoS保障。与互联网“尽力而为”的数据传输不同,网络切片可提供始终如一的低时延和高速率服务保障,这对于安全性要求极高的自动驾驶领域尤为关键。比如,当汽车行驶于网络拥塞区域(比如演唱会、体育场附近),网络切片技术仍然能优先保障汽车通信的高速率和低时延性能。

▲网络切片 vs 无网络切片性能监控 边缘计算是自动驾驶的未来。5G核心网控制面与数据面彻底分离,NFV令网络部署更加灵活,从而使能分布式的边缘计算部署。边缘计算将更多的数据计算和存储从“核心”下沉到“边缘”,部署于接近数据源的地方,一些数据不必再经过网络到达云端处理,从而降低时延和网络负荷,也提升了数据安全性和隐私性。 这对于时延要求极高、数据处理和存储量极大的自动驾驶领域而言,重要性不言而喻。未来对于靠近车辆的移动通信设备,如基站、路边单元等或均将部署车联网的边缘计算,来完成本地端的数据处理、加密和决策,并提供实时、高可靠的通信能力。 所以,自动驾驶需要5G

|